La Fundación del Español Urgente (FundéuRAE), promovida por la Agencia EFE y la Real Academia Española, otorgó recientemente el ‘título de palabra del año 2022’ a la expresión inteligencia artificial (IA), que toma el relevo de confinamiento y vacunas, elegidas en 2020 y 2021.

Ello refleja, una vez más, la relevancia que los desarrollos de inteligencia artificial que tienen en nuestra vida diaria más allá de los círculos tecnológicos. Hoy la probabilidad de obtener un crédito, las oportunidades laborales o las ofertas de comercio electrónico vienen determinados por herramientas de inteligencia artificial basadas en datos y algoritmos que predicen autónomamente nuestra situación socioeconómica, el éxito de nuestro proyecto empresarial o nuestros gustos.

La IA puede traernos numerosos beneficios, desde aumentar la eficiencia de la agricultura y la seguridad de los productos alimentarios, fortalecer la resiliencia frente a desastres naturales diseñar edificios con eficiencia energética o incrementar la exactitud de los diagnósticos médicos.

Pero 2022 fue también un año en el que, como reflejé en un reciente artículo con la profesora Mazzucato surgieron inquietudes serias y preguntas respecto del diseño y el uso de las tecnologías, en particular alrededor de la IA. ¿Cuán completos y de buena calidad son los datos que se están usando? ¿Cómo se están controlando los sesgos económicos y sociales que los algoritmos reflejan y pueden amplificar? ¿Quién tiene el control no solo técnico sino también político de estos desarrollos? Y ¿Quién debería tenerlo?

Muchos de los desarrollos de IA simplemente reproducen o magnifican las desigualdades económicas y de oportunidades, profundizando los sesgos y amenazando con crear un mundo mucho más desigual.

Ya no se puede tener una postura no intervencionista basada en la autorregulación. Dar vía libre al fundamentalismo de mercado es condenar al Estado y a los ciudadanos a reparar más tarde los destrozos (como hemos visto en el contexto de la crisis financiera de 2008 y de la pandemia de COVID 19), con los consecuentes costos financieros y cicatrices sociales inmensas y duraderas que acarrea. En el caso de la IA el riesgo es todavía mayor, porque no sabemos siquiera si una intervención posterior será suficiente. Como señaló hace poco The Economist, es común que hasta los desarrolladores de IA se sorprendan por el poder de sus creaciones.

Gran parte de los desarrollos de inteligencia artificial reproducen o magnifican las desigualdades económicas y de oportunidades. Una postura no intervencionista basada en la autorregulación ya no es posible.

Felizmente, ya sabemos cómo evitar que el laissez faire vuelva a provocar una crisis. Necesitamos impulsar una IA que sea “ética por diseño”, sobre la base de normativas sólidas y de la labor de gobiernos provistos de las capacidades necesarias. Una vez plantados estos pilares, el sector privado podrá y querrá unirse al esfuerzo más amplio para crear tecnologías más seguras y justas.

En particular, se necesita una supervisión pública eficaz. UNESCO, por su mandato de promover el desarrollo de la ciencia y la tecnología desde enfoques éticos, humanos y de derechos humanos elaboró la Recomendación sobre la Ética de la Inteligencia Artificial aprobada por los 193 estados miembros en su Conferencia General a finales de 2021.

Dicha recomendación abarca todas las etapas del ciclo de vida de la IA: desde la investigación, el diseño y el desarrollo, a la implementación, la evaluación, e incluso, su terminación. Además, incorpora compromisos claros y explícitos en el manejo de los datos – acceso y borrado, derecho a control y conocimiento; en auditoria de algoritmos – previendo mandatos a los reguladores, en prohibición de uso para control y social scoring y vigilancia masiva, así como aspectos relativos a la sostenibilidad medioambiental, entre otros.

En el ámbito de avance hacia una IA más ética y responsable, Europa e Iberoamérica son líderes globales. España adoptó en 2021 la Carta de Derechos Digitales incluyendo explícitamente derechos de no discriminación y condiciones de transparencia, auditabilidad, explicabilidad, trazabilidad, supervisión humana y gobernanza ante ante la IA.

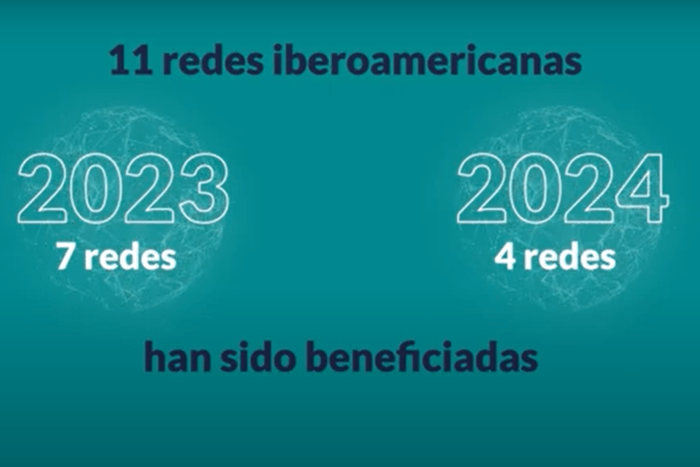

UNESCO lanzará, en partenariado con la CAF, el Consejo Regional para América Latina y el Caribe para la implementación de la Recomendación sobre la Ética de IA de la UNESCO, conformado por países que se comprometen a ser evaluados por sus pares y compartir buenas prácticas. En el grupo de países pioneros se cuenta ya con Argentina, Brasil, Colombia, Ecuador, El Salvador, México y Uruguay, y con Chile como auspiciador de la primera reunión. Y próximamente se instaurará, junto con el coliderazgo de Telefónica y Microsoft, un consejo empresarial con firmas lideres en Iberoamérica.

Europa e Iberoamérica son líderes globales en el avance hacia una inteligencia artificial más ética y responsable

Qué mejor momento que el comienzo de un nuevo año para empezar a sentar las bases hacia una IA al servicio de toda la humanidad. Y qué espacio más adecuado que el Iberoamericano, que inicia un 2023 con la Cumbre Iberoamericana liderada por SEGIB en República Dominicana – uno de los early adopters de la recomendación de UNESCO – y que vivirá un segundo semestre con la UE presidida por España.

El futuro de nuestras sociedades está en juego. No sólo debemos corregir los problemas y controlar los riesgos de la IA, sino también influir en el rumbo general de la transformación digital y de la IA en particular.

Asegurémonos que 2023 sea el año de la inteligencia artificial ética y responsable. Con hechos y con derechos. Para ello pueden contar con UNESCO.